AI换脸+拟声 “深度伪造”的迷局何时能解?

明星现身、专家卖药……一张图片、一段声音,就能生成虚假视频,今年两会期间,雷军等受害者的回应,让AI伪造侵权再次成为热点。

换脸拟声合成视频 AI伪造何时休?

全国人大代表 雷军:有网友说去年国庆放了7天假,8天被我骂醒。网上出现非常非常多的,用我的声音和人脸骂人的内容。刚开始我觉得这是网民喜闻乐见拿我开涮,我也能接受,但是内容比较低劣,多到不得了的时候,就防不胜防了。

除了雷军被恶搞外,AI刘德华虚假宣传,AI张文宏医生和AI工程院院士张伯礼甚至做起了带货主播。

中国政法大学副教授 朱巍:我们现在看到的一些编辑的人脸,包括声音在内,实际上按照民法典的规定,都属于当事人权利人自己的人格权利。未经允许,任何人是不得侵害的,不仅不能直接用,也不能使用当事人的人脸信息、声音信息进行深度合成,不能把它放到深度合成的物料库或场景库里。

持续处置

滥用AI伪造名人形象带货营销

针对滥用AI技术伪造名人形象开展带货营销问题,网信部门持续督促各网站平台进行巡查处置,近一个月,重点网站平台累计处置违法违规账号和店铺797个。

新闻链接

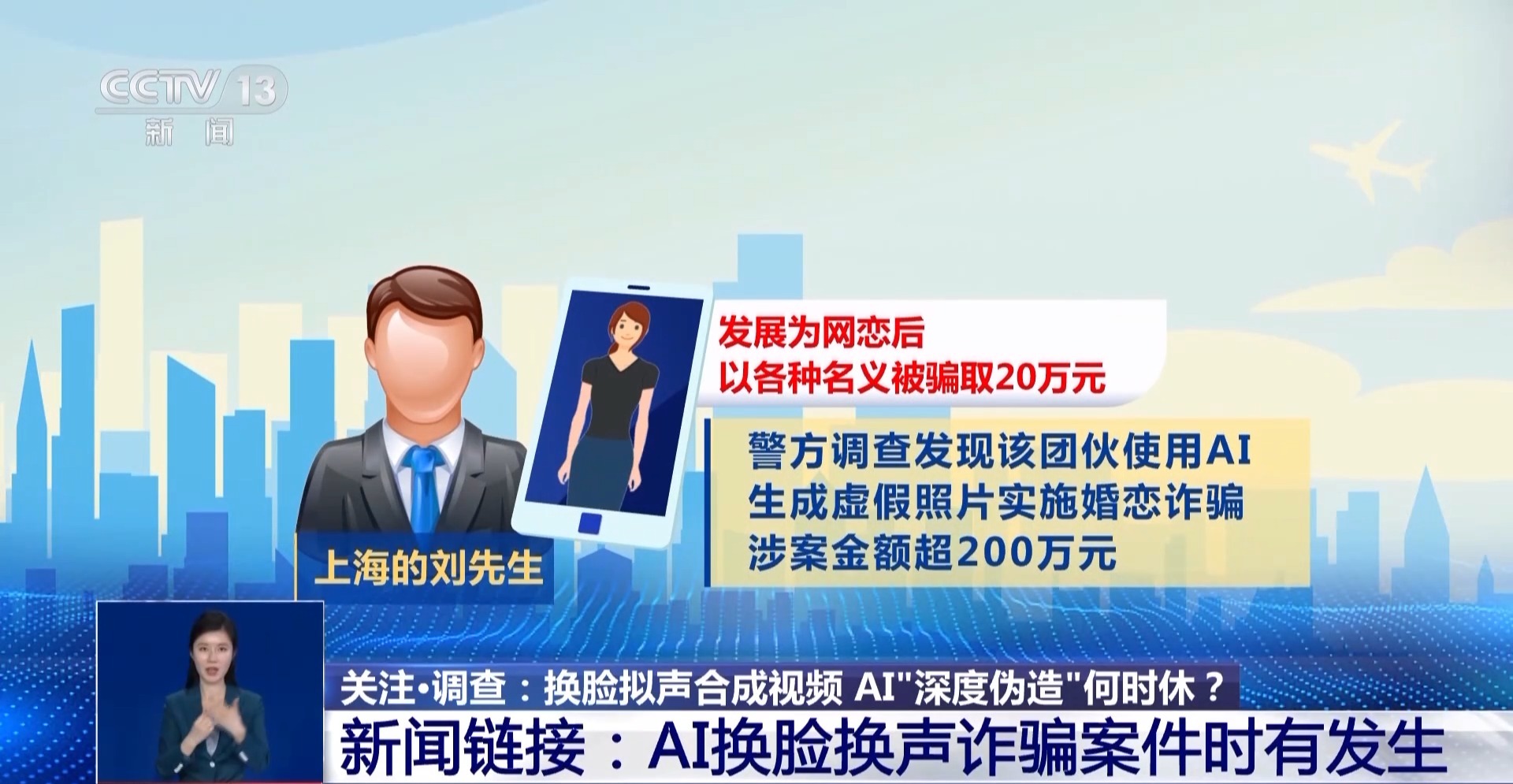

AI换脸换声诈骗案件时有发生

除了伪造名人形象带货营销,AI换脸和语音合成技术还被用于诈骗。犯罪分子通过非法获取的人脸照片和语音样本,利用开源AI工具生成逼真的虚拟形象。

此前内蒙古警方破获的一起AI换脸诈骗案中,福建某科技公司老板郭先生在视频通话中目睹“好友”面容,10分钟内被骗转账430万元,事后发现对方竟是AI换脸与拟声技术合成的“数字替身”。

在另外一起案件中,上海的刘先生在短视频平台结识“焦女士”,发展为网恋后以各种名义被骗取20万元,警方调查发现该团伙使用AI生成虚假照片实施婚恋诈骗,涉案金额超200万元。

AI换脸+拟声

记者体验“深度伪造”

人脸替换、声音模拟,网络上泛滥的AI“深度伪造”究竟是怎么做到的?真的很容易吗?记者找技术人员去做了个测试,将事先录制好的视频换成记者的脸和声音。仅通过记者的证件照片,不到两分钟,视频的人脸就换成了记者的脸。随后是声音的AI制作,记者现场录制了一段声音输入到AI资料库中。

网络技术人员 潘季明:我们收到您的录音片段之后,通过AI算法进行分析和学习,然后通过任意的输入文本,可用您的声音进行朗读。

AI制作的换脸和声音的视频完成后,将两段视频合成后,一段AI生成的记者视频就产生了。

AI合成声音制作视频

购物平台随意定制

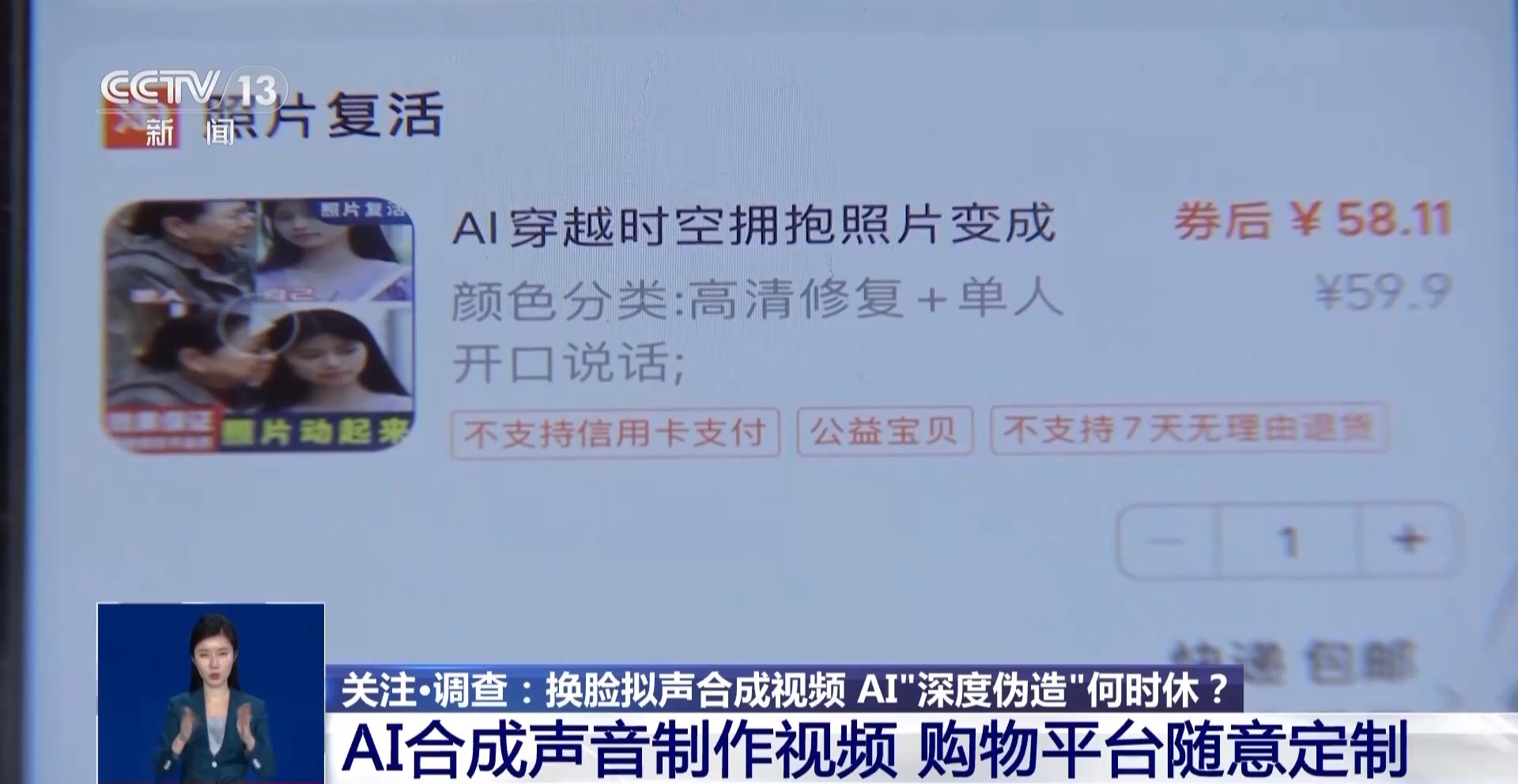

专家表示,AI换脸和换声之类的软件,属于半专业软件,普通网民还不能轻松掌握。但是,记者在调查中发现,普通网民即便不能掌握技术,也能轻松获得自己需要的合成视频。

在购物平台搜索声音克隆,就会出现众多商家。记者发现声音AI深度合成的价格,根据字数不同在20到50元之间。商家告诉记者,只要提供一分钟的语音素材,就可以用AI深度合成该声音的任何话语。其中一个商家还给记者发来了此前客户在他的网店定制的刘德华的声音。

总台央视记者崔世杰介绍,AI深度合成视频分两个步骤,

- 首先是声音克隆,获取目标人的声音。

- 再用目标人的一段视频,将克隆好的声音与之合成,并进行嘴型匹配。

这样一个AI深度合成视频就完成了。

记者选择一家声音克隆的网店,在支付了20元提供了自己的声音模板和文字后,得到了AI深度合成的记者的声音。

记者随后在另一家AI制作视频的网店,支付58元,提供AI深度合成的记者声音和视频后,就得到了AI制作的记者自己的带货视频。

AI伪造视频

违反了哪些法律法规?

针对AI深度合成作品,法律法规有明确的规定。2023年施行的《互联网信息服务深度合成管理规定》要求,任何组织和个人不得利用深度合成服务制作、复制、发布、传播法律、行政法规禁止的信息。

今年9月1日即将实施的《人工智能生成合成内容标识办法》也提出,对AI生成合成内容要进行标识,以便公众识别和区分,防止误导性信息传播。

如何防止人工智能技术被滥用

亟待破题

网店制作、售卖AI声音和视频并没有做任何标识。他们应该承担什么样的法律责任呢?

中国政法大学副教授 朱巍:未经权利人同意随便使用别人的肖像和声音,并且对外发布,至少按照民法典的规定是一种侵权责任,要承担包括损害赔偿、精神损害赔偿在内的相关责任。但如果把这个相关的视频,包括声音编辑之后,形成了相关的内容,那么这个内容如果违反了网络安全法的相关规定,当事人可能要承担包括刑事责任在内的法律责任。

今年两会期间,“应对和防止人工智能技术被滥用”的话题热度始终不减,如何在技术创新和法律约束间找到平衡,是治理虚假信息和谣言传播,亟待破题的关键。

中国计算机学会计算机安全专业委员会委员 吕延辉:AI侵权问题需要从法律、平台和公众多个层面综合施策。法律层面,要进一步完善相关立法,细化AI克隆技术的法律条款,明确侵权行为的定义和责任,同时加强执法力度。